Es gibt Momente, in denen sich ganze Branchen verändern. Und dann gibt es Gesetze, die bestimmen, wie diese Veränderung abläuft. Der EU AI Act gehört zu dieser zweiten Kategorie.

Er ist kein weiteres bürokratisches Regelwerk, sondern der Versuch Europas, die Zukunft der künstlichen Intelligenz verantwortungsvoll zu gestalten – mit Augenmaß, Transparenz und Mut.

Für viele Unternehmerinnen und Unternehmer ist er jedoch noch ein großes Fragezeichen. Was bedeutet dieses Gesetz wirklich? Muss ich mich jetzt fürchten, wenn ich KI in meinem Betrieb nutze? Oder steckt darin sogar eine Chance, sich als verantwortungsbewusstes Unternehmen zu positionieren?

Dieser Artikel bringt Licht ins Dunkel – verständlich, praxisnah und mit Blick darauf, was du jetzt tun kannst, um vorbereitet zu sein.

1. Europas Weg zur vertrauenswürdigen KI

Als 2021 der erste Entwurf des EU AI Acts vorgestellt wurde, war die Euphorie rund um KI-Modelle wie GPT-3 gerade erst am Entstehen. Die EU wollte nicht zusehen, wie sich ein ganzer Technologiezweig unreguliert entwickelt. Ziel war es, einen Rahmen zu schaffen, der Innovation ermöglicht, ohne dass ethische Grenzen überschritten werden.

Während in den USA Marktkräfte bestimmen, und in China der Staat den Kurs vorgibt, versucht Europa einen Mittelweg: Verantwortung übernehmen, ohne den Fortschritt zu bremsen. Vertrauen statt Wildwuchs.

Der AI Act ist also kein Gesetz gegen KI – er ist eine Einladung, KI sicher, fair und nachvollziehbar einzusetzen.

2. Was ist der EU AI Act überhaupt?

Der EU AI Act ist das erste umfassende Gesetz weltweit, das sich ausschließlich mit Künstlicher Intelligenz beschäftigt. Er legt fest, wie KI-Systeme entwickelt, eingesetzt und kontrolliert werden müssen, damit sie den Grundrechten der EU-Bürger entsprechen.

Im Zentrum steht ein Gedanke: Nicht jede KI ist gleich riskant.

Ein Spamfilter ist etwas anderes als eine Gesichtserkennungssoftware oder ein automatisiertes Bewerbungssystem. Deshalb arbeitet der AI Act mit einem risikobasierten Ansatz – je höher das Risiko für Menschen, desto strenger die Regeln.

Das Gesetz baut dabei auf bestehenden Regelungen auf, etwa der DSGVO. Während die DSGVO vor allem den Datenschutz regelt, geht es beim AI Act um Sicherheit, Transparenz und Nachvollziehbarkeit.

3. Der Kern: Der risikobasierte Ansatz

Stell dir vor, Künstliche Intelligenz wäre wie ein Straßenverkehr. Manche Wege sind sicher und offen für alle, andere dürfen nur mit Genehmigung befahren werden – und manche sind schlicht gesperrt, weil sie gefährlich sind. Genau so funktioniert der risikobasierte Ansatz des EU AI Acts.

Er teilt KI-Systeme in vier Stufen ein – von völlig unbedenklich bis absolut verboten – und sorgt damit dafür, dass Regulierung dort greift, wo sie nötig ist, und Innovation dort Raum bekommt, wo sie sicher ist.

Verbotene KI-Systeme bilden die höchste Risikostufe. Das sind Anwendungen, die mit den Grundwerten der EU unvereinbar sind. Dazu gehören Systeme, die Menschen manipulieren oder bewerten – etwa Social Scoring nach chinesischem Vorbild oder Technologien, die Emotionen am Arbeitsplatz erkennen und daraus Entscheidungen ableiten. Hier ist die Linie klar: Diese Systeme dürfen in der EU weder verkauft noch eingesetzt werden.

Eine Stufe darunter befinden sich die Hochrisiko-Systeme. Sie kommen in besonders sensiblen Bereichen zum Einsatz – im Gesundheitswesen, bei der Strafverfolgung, in der Kreditvergabe oder in Bewerbungsverfahren. Hier schreibt der AI Act umfangreiche Prüfungen, Dokumentationen und Kontrollen vor. Unternehmen müssen nachweisen, dass ihre Systeme sicher, nachvollziehbar und diskriminierungsfrei funktionieren. Außerdem ist eine menschliche Aufsicht vorgeschrieben, um Entscheidungen nicht allein Maschinen zu überlassen.

Die begrenzten Risiken betreffen alltägliche Anwendungen, die wir alle bereits nutzen – etwa Chatbots, Empfehlungssysteme oder Tools, die Texte oder Bilder generieren. Hier geht es vor allem um Transparenz. Nutzerinnen und Nutzer sollen erkennen können, dass sie mit einer KI interagieren oder KI-generierte Inhalte sehen. Ein einfacher Hinweis wie „Dieser Text wurde mit KI erstellt“ kann bereits ausreichen, um die Anforderungen zu erfüllen.

Schließlich gibt es noch das minimale Risiko – die große Mehrheit der Anwendungen, zu der etwa Rechtschreibkorrekturen, Spamfilter oder KI-gestützte Übersetzungen gehören. Diese Systeme dürfen ohne besondere Auflagen eingesetzt werden, weil sie keine unmittelbaren Auswirkungen auf die Rechte oder Sicherheit von Menschen haben.

Gerade diese Einteilung zeigt, dass der EU AI Act kein Innovationskiller ist, sondern ein Instrument der Vernunft. Er unterscheidet bewusst zwischen nützlichen, alltäglichen Anwendungen und solchen, die tief in das Leben von Menschen eingreifen. Es geht nicht darum, jede KI unter Generalverdacht zu stellen, sondern genau hinzuschauen, wo sie Schaden anrichten könnte – und wo sie echten Mehrwert bietet.

4. Welche Unternehmen sind betroffen?

Viele glauben, der EU AI Act betreffe nur große Tech-Konzerne – jene, die eigene KI-Modelle entwickeln oder Millionen in Forschung investieren. In Wahrheit betrifft er fast jedes Unternehmen, das heute mit KI arbeitet – also auch deines.

Das Gesetz unterscheidet dabei nicht zwischen Branchen oder Unternehmensgrößen. Entscheidend ist allein, ob KI im Einsatz ist, und welche Aufgaben sie übernimmt. Damit fallen nicht nur Entwickler und Hersteller darunter, sondern auch jene, die KI-Tools im täglichen Betrieb einsetzen oder an Kundinnen und Kunden weitergeben.

Zu den Anbietern zählen Unternehmen, die KI-Systeme entwickeln, herstellen oder vertreiben. Das kann das Start-up sein, das ein Tool zur automatischen Dokumentenanalyse anbietet, genauso wie der Softwareanbieter, der ein Modul für Bildauswertung oder Sprachverarbeitung verkauft.

Nutzer sind alle Unternehmen, die KI aktiv einsetzen – unabhängig davon, ob sie die Technologie selbst entwickelt haben oder extern einkaufen. Das kann ein Marketingteam sein, das Texte mit KI generiert, ein Kundenservice, der Chatbots nutzt, oder ein Personalbüro, das Bewerbungen mit automatisierten Systemen vorsortiert.

Und schließlich betrifft der Act auch Importeure und Dienstleister, die KI-Systeme aus Drittstaaten in die EU bringen oder implementieren – also etwa IT-Dienstleister, Agenturen oder Systemintegratoren, die KI-Lösungen für ihre Kundinnen und Kunden konfigurieren.

Wie das in der Praxis aussieht, zeigen ein paar Beispiele:

Ein österreichisches KMU im Personalwesen nutzt ein KI-gestütztes Recruiting-Tool, das Lebensläufe analysiert und Bewerbungen nach Eignung sortiert. Was zunächst wie eine nützliche Arbeitserleichterung klingt, fällt laut AI Act in die Kategorie „Hochrisiko-Systeme“. Denn hier entscheidet die KI indirekt über berufliche Chancen – und damit über Menschen. Das Unternehmen muss also prüfen, ob das Tool konform ist, welche Daten verarbeitet werden und ob eine menschliche Kontrolle vorgesehen ist.

Ein Onlinehändler wiederum setzt einen Chatbot ein, um Kundinnen und Kunden bei Bestellungen zu unterstützen. Das ist grundsätzlich erlaubt, gilt aber als „begrenztes Risiko“. Wichtig ist, dass die Kundinnen wissen, dass sie mit einer KI sprechen – etwa durch einen Hinweis im Chatfenster.

Ein Industriebetrieb nutzt KI-basierte Systeme, um Produktionsfehler zu erkennen und Qualitätskontrollen zu optimieren. Auch hier handelt es sich um ein Hochrisiko-System, weil Fehlentscheidungen Auswirkungen auf Sicherheit und Gesundheit haben können – etwa, wenn defekte Teile übersehen werden.

Oder denk an eine Immobilienagentur, die KI verwendet, um automatisiert Mietpreise zu berechnen oder Bonitätsprüfungen durchzuführen. Auch das kann in die Kategorie Hochrisiko fallen, weil hier algorithmische Entscheidungen finanzielle Konsequenzen für Menschen haben.

Selbst wenn du als Unternehmerin oder Unternehmer nur indirekt mit KI zu tun hast – etwa über eine beauftragte Agentur, die KI in ihren Workflows einsetzt – bist du nicht aus der Verantwortung entlassen. Du haftest zwar nicht für die Technologie selbst, aber für die Sorgfalt bei der Auswahl deiner Partner.

Deshalb lohnt es sich, genau hinzusehen, mit welchen Tools und Anbietern du arbeitest – und ob sie offenlegen, wo ihre Daten liegen, wie sie trainiert wurden und welche Schutzmaßnahmen sie einsetzen.

5. Pflichten nach Risikokategorie

Der AI Act definiert klare Pflichten, abgestimmt auf das Risiko.

Unternehmen, die Hochrisiko-Systeme einsetzen oder entwickeln, müssen ein umfangreiches Risikomanagementsystem etablieren. Dazu gehören:

- Technische Dokumentation und Nachweise zur Sicherheit

- Prüfungen durch benannte Stellen

- menschliche Aufsicht und Fehlerkontrolle

- Registrierung des Systems in einer EU-Datenbank

Bei begrenztem Risiko genügt in der Regel ein transparenter Hinweis, dass KI im Einsatz ist.

Bei minimalem Risiko besteht keine Pflicht – aber viele Unternehmen nutzen die Gelegenheit, um freiwillig Standards einzuhalten und Vertrauen zu stärken.

Verbotene Systeme dürfen schlichtweg nicht in Verkehr gebracht werden.

Diese klare Staffelung zeigt, dass es nicht um Kontrolle um der Kontrolle willen geht – sondern um bewussten, verantwortungsvollen Einsatz.

6. Was bedeutet das konkret für dein Unternehmen?

Hier beginnt der praxisnahe Teil. Was musst du jetzt tun?

Zuerst: keine Panik.

Der AI Act ist nicht dazu da, Innovation zu ersticken, sondern sie zu lenken. Wenn du strukturiert vorgehst, ist der Aufwand überschaubar.

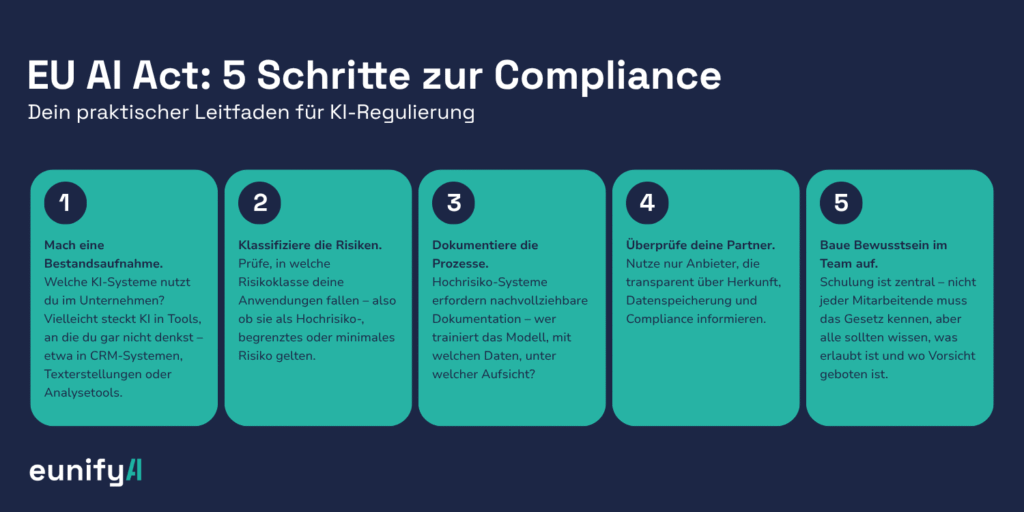

Schritt 1: Mach eine Bestandsaufnahme.

Welche KI-Systeme nutzt du im Unternehmen? Vielleicht steckt KI in Tools, an die du gar nicht denkst – etwa in CRM-Systemen, Texterstellungen oder Analysetools.

Schritt 2: Klassifiziere die Risiken.

Prüfe, in welche Risikoklasse deine Anwendungen fallen – also ob sie als Hochrisiko-, begrenztes oder minimales Risiko gelten. Wenn du unsicher bist, helfen offizielle EU-Leitfäden, Branchenverbände oder Fachportale dabei, die Einstufung zu verstehen. Auch im eunifyAI-Blog findest du praxisnahe Beispiele und aktuelle Informationen rund um den AI Act, die dir bei der Orientierung helfen können.

Schritt 3: Dokumentiere die Prozesse.

Hochrisiko-Systeme erfordern nachvollziehbare Dokumentation – wer trainiert das Modell, mit welchen Daten, unter welcher Aufsicht?

Schritt 4: Überprüfe deine Partner.

Nutze nur Anbieter, die transparent über Herkunft, Datenspeicherung und Compliance informieren.

Schritt 5: Baue Bewusstsein im Team auf.

Schulung ist zentral – nicht jeder Mitarbeitende muss das Gesetz kennen, aber alle sollten wissen, was erlaubt ist und wo Vorsicht geboten ist.

7. Chancen statt Bürokratie

Viele befürchten, der AI Act würde Europa bremsen. Doch das Gegenteil ist der Fall.

Ein klarer Rechtsrahmen bedeutet Vertrauen – bei Kundinnen und Kunden, bei Partnern und auch bei Investorinnen und Investoren. Wenn du als Unternehmen zeigen kannst, dass du verantwortungsvoll mit KI umgehst, ist das kein Nachteil, sondern ein echter Wettbewerbsvorteil.

Stell dir zwei Unternehmen vor, die fast das Gleiche anbieten. Beide nutzen KI, um ihre Prozesse effizienter zu gestalten. Doch während das erste Unternehmen damit wirbt, „KI-optimierte Produkte“ zu haben, geht das zweite einen Schritt weiter: Es kommuniziert offen, dass seine KI-Lösungen DSGVO-konform, überprüft und nachvollziehbar sind. Es erklärt, wie Daten verarbeitet werden und warum Kundendaten sicher sind.

In einer Zeit, in der Vertrauen zur neuen Währung geworden ist, entscheidet genau dieser Unterschied. Das zweite Unternehmen wirkt glaubwürdig, verantwortungsbewusst – und damit moderner. Es gewinnt nicht nur Kunden, sondern auch Mitarbeiterinnen, Investoren und Partner, die dieselben Werte teilen.

Genau hier liegt die Chance: Der EU AI Act zwingt niemanden zum Stillstand, sondern schafft Orientierung. Er belohnt jene, die mit Transparenz und Verantwortung führen – und hebt sie sichtbar vom Rest des Marktes ab.

8. Sanktionen und Durchsetzung

Natürlich hat jedes Gesetz Zähne.

Beim AI Act sind die Sanktionen erheblich: Bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes können fällig werden – je nachdem, was höher ist.

Zuständig für die Kontrolle sind nationale Marktüberwachungsbehörden, unterstützt durch ein neu geschaffenes „European AI Office“.

Doch Bußgelder sind nur ein Teil der Wahrheit.

Die eigentliche Gefahr liegt im Vertrauensverlust. Wenn herauskommt, dass ein Unternehmen nicht konform arbeitet oder gar ein verbotenes System nutzt, ist der Imageschaden kaum zu reparieren.

Darum ist Prävention so viel günstiger – nicht nur finanziell, sondern auch reputativ.

9. So kannst du dich vorbereiten

Du musst kein Jurist sein, um den AI Act umzusetzen.

Es genügt, strukturiert vorzugehen – am besten in fünf Schritten:

Erstens: Selbstcheck durchführen.

Mach dir klar, welche Systeme du nutzt und welche Daten verarbeitet werden.

Zweitens: Inventur erstellen.

Erfasse alle KI-Anwendungen und ihre Funktionen.

Drittens: Risiken bewerten.

Bewerte jedes Tool hinsichtlich möglicher Auswirkungen auf Kunden, Mitarbeitende oder Dritte.

Viertens: Verträge prüfen.

Achte auf DSGVO- und AI-Act-Klauseln bei Software- und Cloudanbietern.

Fünftens: Mitarbeitende sensibilisieren.

Schaffe ein Klima, in dem Transparenz und Verantwortung selbstverständlich sind.

Diese Schritte sind nicht nur Pflicht, sondern helfen dir auch, Prozesse besser zu verstehen. Viele Unternehmen entdecken dabei Potenziale, wie sie KI noch gezielter einsetzen können.

10. Der AI Act im Zusammenspiel mit anderen Regelwerken

Der AI Act steht nicht isoliert da.

Er ist Teil eines größeren europäischen Puzzles: Neben der DSGVO (Datenschutz), dem Digital Services Act (Verantwortung digitaler Plattformen) und dem Digital Markets Act (Wettbewerbsgleichgewicht) bildet er das Fundament für Europas digitalen Binnenmarkt.

Für Unternehmen bedeutet das: Compliance ist kein Projekt mehr, das man „irgendwann“ erledigt, sondern ein fortlaufender Prozess. Wer heute sauber arbeitet, hat morgen weniger Aufwand.

Gerade für kleine und mittlere Betriebe lohnt es sich, Partner zu wählen, die den Überblick behalten – und ihre Tools regelmäßig prüfen lassen.

11. Europas Weg: Souveränität durch Verantwortung

Während viele Länder auf Geschwindigkeit setzen, entscheidet sich Europa für Bewusstsein.

Das ist kein Zeichen von Schwäche, sondern von Reife.

Mit dem AI Act übernimmt die EU globale Verantwortung. Sie setzt Standards, an denen sich andere orientieren werden. Das stärkt nicht nur europäische Unternehmen, sondern auch das Vertrauen der Verbraucherinnen und Verbraucher.

Und letztlich geht es genau darum: Vertrauen.

Denn künstliche Intelligenz ist mächtig – aber ohne Vertrauen bleibt sie nur Code.