Stell dir vor: Du arbeitest in einem Unternehmen, das zunehmend auf KI-Tools setzt – etwa zur Datenanalyse oder für Automatisierung. Alles läuft, das Potenzial ist riesig. Und doch – irgendwo im Hintergrund lauert eine unsichtbare Hürde: Wo genau werden diese Daten gespeichert? In welchem Land, in welchem Rechenzentrum? Und welche Konsequenzen hat das für Sicherheit, Compliance und Vertrauen?

Dieses Thema, das oft unterschätzt wird, nennt sich Datenresidenz. Genau darum geht es in diesem Artikel – und warum insbesondere beim Einsatz von KI-Werkzeugen dieser Punkt entscheidend werden kann.

Unser Ziel: Du bekommst ein klares Verständnis dafür, warum die Frage nach dem Speicherort von Daten heutzutage eine fundamentale Rolle spielt – vor allem wenn KI-Systeme mitspielen.

Was ist Datenresidenz?

„Datenresidenz“ beschreibt im Kern den physischen und geografischen Speicherort von Daten – also den Ort, an dem Informationen tatsächlich liegen, sobald sie gespeichert werden.

Stell dir vor, jede Datei, jede Kundendatenbank oder jeder KI-Datensatz hätte eine Postadresse. Diese Adresse – das ist die Datenresidenz.

In der Praxis kann das ganz unterschiedlich aussehen:

- On-Premise-Lösungen bedeuten, dass die Daten auf eigenen Servern im Unternehmen lagern. Du weißt genau, in welchem Raum, in welchem Rack und auf welcher Festplatte sie sich befinden. Das bietet maximale Kontrolle, erfordert aber auch eigene Sicherheits-, Backup- und Wartungsstrukturen.

- Cloud-Speicher in der EU, etwa bei europäischen Rechenzentrumsbetreibern oder bei internationalen Cloud-Anbietern mit EU-Standorten (z. B. Frankfurt, Amsterdam, Paris), kombinieren Skalierbarkeit mit einem rechtlich sicheren Rahmen nach DSGVO.

- Internationale oder hybride Infrastrukturen, bei denen Daten z. B. in den USA, Asien oder über mehrere Kontinente verteilt gespeichert sind, können zwar leistungsstark und günstig sein, werfen aber komplexe Fragen auf: Welche Gesetze gelten dort? Wer darf auf die Daten zugreifen? Und was passiert, wenn Behörden anderer Länder Einsicht verlangen?

Datenresidenz grenzt sich dabei klar von verwandten Konzepten ab:

- Datensouveränität beschreibt das Recht, über die eigenen Daten zu bestimmen – wer sie besitzt, wer sie nutzen darf und zu welchem Zweck.

- Datengrenzen oder Data Localization beziehen sich auf rechtliche oder politische Vorgaben, die vorschreiben, dass bestimmte Daten das Land nicht verlassen dürfen (wie z. B. bei Gesundheitsdaten oder in staatlichen Behörden).

Diese Unterscheidungen sind wichtig, weil sie über die rechtliche Verantwortung und Kontrolle entscheiden. Ein Unternehmen kann also zwar datensouverän sein, seine Daten aber trotzdem außerhalb des eigenen Rechtsraums gespeichert haben – und damit Risiken eingehen, die es oft gar nicht sieht.

Die Wahl des Speicherorts beeinflusst daher nicht nur technische Faktoren wie Performance, Latenz und Redundanz, sondern auch entscheidend die rechtliche Sicherheit, Datenschutz-Compliance und das Vertrauen der Kund:innen.

Kurz gesagt: Datenresidenz ist die unsichtbare Basis, auf der jedes digitale Vertrauen ruht.

Warum ist Datenresidenz wichtig?

Rechtliche & regulatorische Anforderungen

Je nach Land variieren Gesetze zum Datenschutz und zur Speicherung von Daten stark. Wenn Daten z. B. in einem Rechenzentrum außerhalb Europas liegen, können andere Datenschutz- oder Sicherheitsstandards gelten – oder es gelten zusätzliche Export-, Zugriff- oder Überwachungsregelungen. Unternehmen, die weltweit agieren oder internationale Cloud-Dienste nutzen, müssen daher oft nachweisen, dass sie die Datenschutzregeln mehrerer Länder gleichzeitig einhalten.

Compliance & Datenschutz

Wenn personenbezogene oder besonders schützenswerte Daten (z. B. Gesundheits-, Finanz- oder Behörden-Daten) verarbeitet werden, spielt der Speicherort eine große Rolle. Datenresidenz kann als Teil einer Datenschutzstrategie dienen: Wer kontrolliert den physischen Standort, wer kontrolliert Zugriffe, wie ist die Datenintegrität gewährleistet?

Risiken bei Nichteinhaltung

Lange Zeit hat sich kaum jemand Gedanken darüber gemacht, wo Daten eigentlich gespeichert werden – Hauptsache, alles lief stabil. Doch das Bewusstsein verändert sich. Immer mehr Kund:innen und Geschäftspartner:innen wollen wissen, wo ihre Daten liegen und was damit passiert.

Gesetzlich: Wer gegen Datenschutz- oder Speicherpflichten verstößt, riskiert hohe Strafen und Auflagen. Besonders heikel ist es, wenn Daten außerhalb der EU verarbeitet werden und dort andere Zugriffsrechte gelten.

Vertrauen: Transparenz schafft Sicherheit. Unternehmen, die offenlegen können, wo ihre Daten gespeichert sind, stärken ihre Glaubwürdigkeit. Wer das nicht kann, weckt Zweifel – selbst ohne konkreten Vorfall.

Finanziell: Datenpannen, Bußgelder oder Systemausfälle können hohe Kosten verursachen und Ressourcen binden, die anderswo dringend gebraucht würden.

Wettbewerb: Firmen mit klarer Datenstrategie und Standorttransparenz wirken professioneller – und werden zunehmend bevorzugt, wenn Vertrauen oder Compliance eine Rolle spielen.

Kurz gesagt: Datenresidenz ist kein Randthema mehr, sondern ein wichtiger Teil dessen, wie Vertrauen in der digitalen Welt entsteht.

Datenresidenz im Kontext von KI-Tools

Wie KI-Tools Daten nutzen und verarbeiten

KI-Tools leben von Daten – und zwar vielen. Sie analysieren Kundenanfragen, werten Dokumente aus oder lernen aus Nutzungsverhalten. Dabei fließen Informationen oft aus verschiedenen Quellen zusammen: Website, CRM-System, E-Mails oder Cloud-Dienste.

Je mehr Anwendungen verbunden sind, desto unübersichtlicher wird es. Plötzlich liegen Daten an verschiedenen Orten – teils in Österreich, teils in Irland, teils vielleicht in den USA. Und genau das macht die Sache komplex.

Der Speicherort bestimmt, unter welchen rechtlichen Bedingungen ein KI-Tool die Daten verarbeiten darf – und wie sicher diese Daten tatsächlich sind. Selbst kleine Unternehmen können dadurch unbeabsichtigt in rechtliche Grauzonen geraten, etwa wenn ein Cloud-Dienst Daten außerhalb Europas speichert.

Warum der Speicherort entscheidend ist

Für kleine Betriebe geht es weniger um technische Feinheiten als um Sicherheit, Kontrolle und Vertrauen. Wenn Daten an mehreren Orten liegen, kann es schwierig werden, Zugriffsrechte zu überblicken oder im Ernstfall zu reagieren.

Auch die Leistung spielt eine Rolle: Wenn Daten zwischen verschiedenen Servern pendeln, kann das Systeme verlangsamen oder Prozesse instabil machen.

Ein klar definierter Plan für Datenresidenz – also die bewusste Entscheidung, wo Daten gespeichert werden dürfen und wo nicht – hilft, Ordnung zu schaffen. So bleibt die Datenqualität hoch und das Risiko gering.

Typische Stolpersteine bei KI-gestützter Datenverarbeitung

Gerade kleinere Unternehmen nutzen KI-Tools häufig „out of the box“, ohne zu wissen, wo die dahinterliegenden Server stehen. Dabei lohnt sich ein kurzer Blick in die Datenschutzerklärung oder ins technische Handbuch:

- Wird das Tool in der EU gehostet oder außerhalb?

- Wie werden Kundendaten gespeichert oder anonymisiert?

- Gibt es die Möglichkeit, ein EU-Rechenzentrum auszuwählen?

Diese Fragen helfen, unbewusste Risiken zu vermeiden – bevor sie entstehen. Und spätestens, wenn KI-Tools sensible Informationen verarbeiten (z. B. Kundendaten oder interne Dokumente), wird der Speicherort zu einem wichtigen Entscheidungskriterium.

Regulatorische Vorgaben wie der EU AI Act werden diesen Trend künftig noch verstärken.

Branchen, in denen Datenresidenz besonders wichtig ist

Auch kleine Unternehmen können betroffen sein – vor allem, wenn sie in sensiblen Bereichen arbeiten:

- Gesundheit & Fitness: Wenn etwa ein Studio mit Gesundheitsdaten arbeitet oder KI-basierte Auswertungen anbietet, ist klar festgelegter Datenschutz Pflicht.

- Finanzdienstleistungen & Versicherungen: Kundendaten, Rechnungen oder Bonitätsprüfungen sind besonders sensibel.

- Öffentliche Aufträge oder Bildung: Wer mit Behörden zusammenarbeitet, muss oft nachweisen, dass alle Daten innerhalb der EU gespeichert werden.

Für alle anderen gilt: Auch wenn du keine sensiblen Daten verarbeitest, kann es Vertrauen schaffen, deinen Kund:innen zu sagen, wo ihre Daten liegen. Gerade im B2B-Bereich ist das ein Pluspunkt – und oft ein Türöffner für neue Kooperationen.

Auswirkungen auf Unternehmen und Organisationen

Was Unternehmen jetzt beachten sollten

Auch kleine Betriebe verarbeiten heute mehr Daten, als ihnen oft bewusst ist – von Kundendaten über Newsletter-Listen bis hin zu Cloud-Backups oder KI-gestützten Analysen. Wer dabei Tools nutzt, deren Server außerhalb der EU stehen, kann schnell in einen Graubereich geraten.

Deshalb lohnt es sich, ein paar einfache Grundsätze festzulegen:

- Wo liegen meine Daten wirklich? (nicht nur laut Marketingversprechen)

- Wer hat Zugriff – intern und extern?

- Was passiert, wenn der Anbieter den Speicherort ändert oder verkauft wird?

Gerade wenn Partnerfirmen oder Dienstleister ins Spiel kommen, kann das Thema komplizierter werden. Doch ein klarer Überblick schafft Sicherheit – und schützt vor bösen Überraschungen.

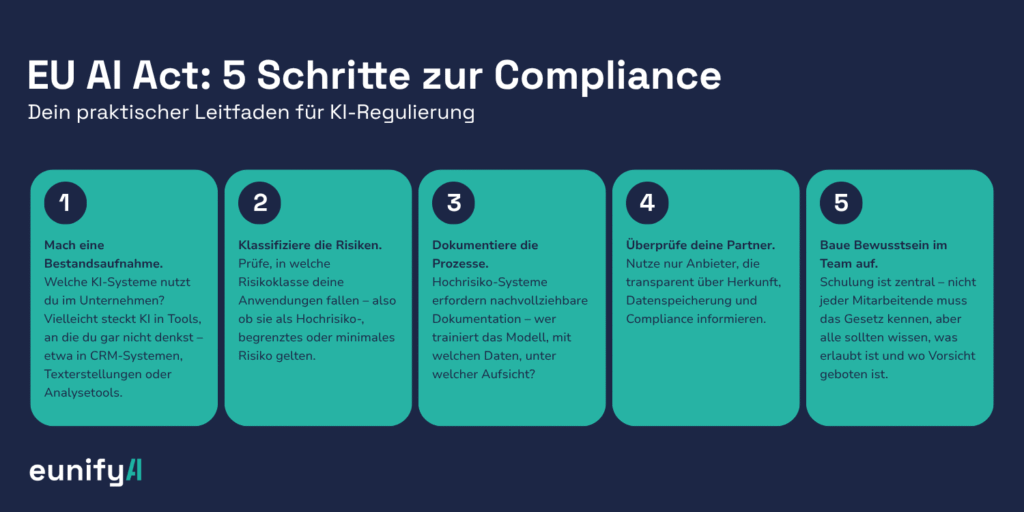

Strategien und Richtlinien zur Datenresidenz – pragmatisch gedacht

Man braucht dafür kein 30-seitiges Konzept. Schon ein übersichtliches internes Dokument kann helfen, Ordnung zu schaffen. Zum Beispiel:

- Eine einfache Einstufung, welche Daten sensibel sind und besondere Anforderungen haben (z. B. Kundendaten, Rechnungen, Gesundheitsinformationen).

- Eine Entscheidungstabelle, welche Anbieter und Speicherorte erlaubt sind.

- Vertragsklauseln, die sicherstellen, dass Cloud-Anbieter Daten in der EU speichern.

- Ein jährlicher Check, ob sich an den Speicherbedingungen etwas geändert hat.

So entsteht schrittweise eine Datenresidenz-Strategie, die nicht überfordert, aber Sicherheit schafft – auch bei künftigen Gesetzesänderungen wie dem EU AI Act oder neuen Datenschutzbestimmungen.

Warum sich der Aufwand lohnt

Wer das Thema ernst nimmt, gewinnt Vertrauen. Nicht nur bei Kund:innen, sondern auch bei Geschäftspartner:innen, Banken oder Förderstellen. Immer häufiger fragen diese gezielt nach Hosting-Standorten und Datenschutzmaßnahmen.

Unternehmen, die hier klar Auskunft geben können, haben einen echten Vorteil:

- Sie gelten als professionell und verantwortungsbewusst.

- Sie erfüllen schneller Anforderungen bei öffentlichen Aufträgen oder EU-Projekten.

- Sie vermeiden Stress, falls sich Datenschutzgesetze weiter verschärfen.

Wie wichtig Transparenz und Kontrolle beim Einsatz von KI-Tools sind, zeigt übrigens auch unser Artikel „KI-Agents im Browser – Risiko oder Chance für Europas Wirtschaft“.

Praktische Tipps für den Alltag

Auswahl von Cloud- und Speicheranbietern

- Wähle Anbieter mit Rechenzentren in der EU – idealerweise mit Standortwahl.

- Prüfe in den Datenschutzbestimmungen, wo Daten tatsächlich gespeichert werden.

- Vereinbare, dass Daten nicht automatisch in Drittstaaten verschoben werden dürfen.

- Achte auf Zertifizierungen wie ISO 27001 oder EU Cloud Code of Conduct.

Organisatorische Maßnahmen

- Lege fest, wer intern Zugriff auf sensible Daten hat.

- Verwende Verschlüsselung, sowohl beim Speichern als auch bei der Übertragung.

- Führe regelmäßig Überprüfungen oder kleine Audits durch – z. B. einmal jährlich.

- Dokumentiere Änderungen, etwa wenn du neue Tools einsetzt oder Cloud-Verträge wechselst.

KI-Tools bewusst auswählen

Viele moderne Anwendungen bieten bereits Funktionen, um Datenschutz und Datenresidenz zu unterstützen – etwa durch Serverauswahl oder Pseudonymisierung. Achte darauf, solche Optionen zu nutzen.

Wenn du mehrere KI-Dienste kombinierst, kann sich auch der Einsatz spezieller Datenmanagement-Tools lohnen: Sie helfen, Speicherorte, Zugriffsrechte und Datenflüsse zentral im Blick zu behalten – ein Pluspunkt, gerade wenn du wachsen möchtest.